ИИ-агенты как новая угроза

В сентябре 2025 года компания Anthropic раскрыла детали тревожного инцидента: поддерживаемый государством злоумышленник применил ИИ-агента для написания кода, чтобы провести полностью автономную кибершпионскую кампанию против тридцати организаций по всему миру. Искусственный интеллект самостоятельно взял на себя до 90% тактических задач — от разведки и написания эксплойтов до попыток горизонтального перемещения по инфраструктуре, действуя на скорости машин.

Сам по себе этот случай уже вызывает беспокойство. Но для служб информационной безопасности существует еще более пугающий сценарий: атакующему даже не нужно проходить классическую цепочку взлома, потому что он заранее скомпрометировал ИИ-агента, который уже находится внутри периметра. Того самого агента, у которого уже есть легитимный доступ, широкие разрешения и законные основания ежедневно перемещаться между системами.

Модель, созданная для защиты от человека

Традиционная модель кибератаки (kill chain), разработанная Lockheed Martin в 2011 году, исходит из того, что злоумышленнику приходится буквально «выгрызать» каждый шаг. Эта концепция описывает путь противника от первоначального проникновения до достижения цели и долгие годы определяла подходы к обнаружению вторжений.

Логика проста: атакующий должен пройти последовательные этапы, и защитники могут прервать цепочку на любом из них. Каждый шаг злоумышленника — это еще одна возможность его перехватить.

Типичное вторжение развивается по следующим стадиям:

первоначальный доступ (через уязвимость или иным способом);

закрепление в системе без срабатывания сигнатур;

разведка для изучения инфраструктуры;

горизонтальное перемещение к ценным данным;

повышение привилегий, если текущих прав недостаточно;

хищение данных в обход систем контроля.

Каждый этап создает возможности для детектирования: средства защиты конечных точек могут заметить вредоносную нагрузку, сетевой мониторинг — необычное горизонтальное движение, системы управления идентификацией — попытку повышения привилегий, а SIEM-решения — аномальное поведение, распределенное по разным системам. Чем больше шагов делает нарушитель, тем выше вероятность, что он заденет какой-нибудь датчик.

Именно поэтому сложные противники, такие как LUCR-3 или APT29, тратят недели на скрытное существование, сливаясь с нормальным трафиком и используя легитимные инструменты. Но даже они оставляют артефакты: необычное местоположение входа, странные паттерны доступа, незначительные отклонения от привычного поведения. Современные системы детектирования как раз и нацелены на поиск таких аномалий.

Проблема в том, что ИИ-агенты не следуют этому сценарию.

Чем уже обладает ИИ-агент

Принцип работы ИИ-агентов кардинально отличается от действий человека. Они функционируют в разных системах, перемещают данные между приложениями и работают непрерывно. Если такой агент скомпрометирован, атакующий минует всю цепочку атак целиком — сам агент становится этой цепочкой.

Задумайтесь о типичном наборе прав ИИ-агента. Его история активности — это идеальная карта того, какие данные существуют и где они хранятся. Скорее всего, он получает данные из Salesforce, отправляет в Slack, синхронизируется с Google Drive и обновляет ServiceNow в рамках обычного рабочего процесса. При развертывании ему часто выдают широкие полномочия, зачастую на уровне администратора во множестве приложений, и он уже перемещает данные между системами как часть своей штатной работы.

Злоумышленник, захвативший такого агента, получает всё это мгновенно. Ему достается карта инфраструктуры, доступы, разрешения и легитимный повод для перемещения данных. Все этапы kill chain, которые службы безопасности годами учились выявлять, агент просто пропускает по умолчанию.

Угроза уже реальна

Кризис, связанный с OpenClaw, показал, как это выглядит на практике. Около 12% навыков в его публичном маркете оказались вредоносными. Критическая уязвимость удаленного выполнения кода позволяла скомпрометировать систему одним кликом. Более 21 тысячи экземпляров были доступны публично. Но самое тревожное — это то, к чему мог получить доступ скомпрометированный агент, подключенный к Slack и Google Workspace: сообщения, файлы, электронные письма, документы, причем с сохранением контекста между сеансами.

Главная проблема в том, что средства защиты настроены на выявление ненормального поведения. Когда атакующий использует существующий рабочий процесс ИИ-агента, всё выглядит абсолютно обыденно. Агент обращается к тем же системам, что и всегда, перемещает те же данные, работает в те же часы.

Это и есть тот самый разрыв в обнаружении, с которым сегодня сталкиваются команды безопасности.

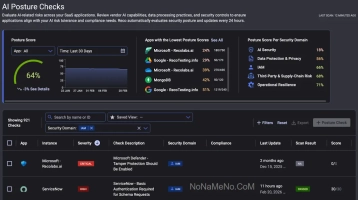

Как Reco закрывает пробел в видимости

Защита от скомпрометированных ИИ-агентов начинается с понимания того, какие агенты работают в вашей среде, к чему они подключены и какими правами обладают. В большинстве организаций нет даже инвентаризации ИИ-агентов, взаимодействующих с SaaS-экосистемой. Именно для решения таких задач и была создана платформа Reco.

Обнаружение всех ИИ-агентов

Reco Agentic AI Security выявляет каждого ИИ-агента, встроенные AI-функции и сторонние интеграции с искусственным интеллектом во всей SaaS-среде, включая теневые AI-инструменты, подключенные без одобрения IT-отдела.

Карта доступа и потенциальный радиус поражения

Для каждого агента платформа определяет, к каким SaaS-приложениям он подключен, какими правами обладает и к каким данным может получить доступ. Визуализация связей SaaS-to-SaaS показывает, как агенты интегрируются в экосистему приложений, выявляя опасные комбинации, где ИИ-агенты соединяют системы через MCP, OAuth или API, создавая разрывы в разрешениях, которые ни один владелец приложения не стал бы утверждать.

Выявление целей и применение минимальных привилегий

Reco определяет, какие агенты представляют наибольший риск, оценивая их права, кросс-системный доступ и чувствительность данных. Агенты, связанные с потенциальными угрозами, автоматически маркируются. После этого платформа помогает скорректировать доступы через управление идентификационными правами, напрямую ограничивая возможный ущерб в случае компрометации агента.

Обнаружение аномальной активности агентов

Движок обнаружения угроз Reco применяет поведенческий анализ, ориентированный на идентичность, к ИИ-агентам так же, как и к учетным записям пользователей, в реальном времени отличая нормальную автоматизацию от подозрительных отклонений.

Что это значит для вашей команды

Традиционная kill chain предполагала, что злоумышленнику приходится бороться за каждую крупицу доступа. ИИ-агенты полностью переворачивают это допущение.

Один скомпрометированный агент предоставляет атакующему легитимный доступ, идеальную карту инфраструктуры, широкие разрешения и встроенное прикрытие для перемещения данных — без единого шага, который выглядел бы как вторжение.

Команды безопасности, которые по-прежнему сосредоточены исключительно на выявлении действий человека-злоумышленника, упустят эту угрозу. Противник будет действовать внутри существующих рабочих процессов ваших ИИ-агентов, оставаясь невидимым в шуме нормальных операций.

Рано или поздно ИИ-агент в вашей инфраструктуре станет целью. Видимость — это то, что отличает раннее обнаружение от разбирательства уже после инцидента. Reco предоставляет эту видимость во всей вашей SaaS-экосистеме за считанные минуты.